[2026-03-17] 로봇 시뮬레이션의 '차원'이 다르다: 2D 비디오를 넘어 4D로 진화한 Kinema4D

그동안 Embodied AI 분야에서 ‘시뮬레이터’라고 하면 두 부류뿐이었죠. 물리 엔진 기반의 딱딱한 전통적 시뮬레이터, 아니면 최근 유행하는 ‘그럴싸해 보이기만 하는’ 2D 비디오 생성 모델 말입니다. 하지만 진짜 로봇이 구동되는 환경은 2D 화면이 아니라 시간축이 포함된 4D 공간입니다.

기존 비디오 생성 모델들은 픽셀 값은 잘 맞출지 몰라도, 로봇 팔이 물체를 지나치거나 공간적 거리감을 상실하는 ‘할루시네이션’에서 자유롭지 못했습니다. 오늘 소개할 Kinema4D는 이 문제를 해결하기 위해 로봇의 URDF(Unified Robot Description Format)를 디퓨전 모델의 핵심 제어 신호로 끌어들였습니다. 단순히 비디오를 만드는 게 아니라, 물리적으로 타당한 4D 세계를 ‘연성’해내는 이 모델의 밑바닥을 파헤쳐 보죠.

TL;DR: Kinema4D는 로봇의 기구학(Kinematics) 정보를 4D 포인트맵으로 변환해 디퓨전 트랜스포머(DiT)를 제어함으로써, 물리적 일관성이 보장된 RGBD 시퀀스를 생성하는 미친 효율의 시뮬레이터입니다.

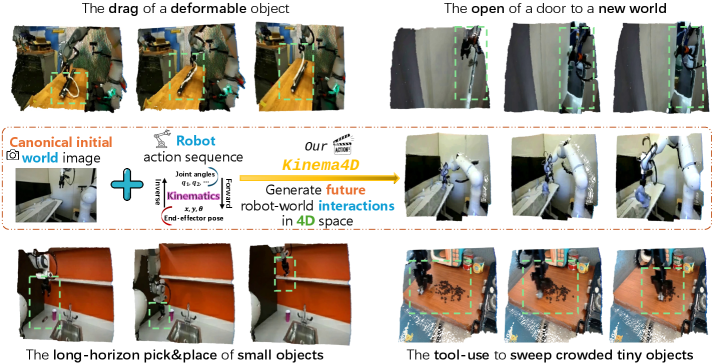

이미지 1: Kinema4D의 핵심 컨셉. 단순 비디오 생성이 아니라 공간적 제약을 이해하는 4D 시뮬레이션을 지향해요.

이미지 1: Kinema4D의 핵심 컨셉. 단순 비디오 생성이 아니라 공간적 제약을 이해하는 4D 시뮬레이션을 지향해요.

⚙️ URDF가 디퓨전을 만났을 때: 4D 생성 파이프라인

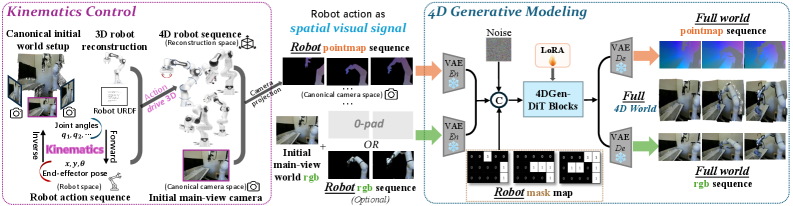

Kinema4D의 핵심은 ‘분리(Disentanglement)’에 있습니다. 로봇의 움직임은 정밀한 계산(Kinematics)으로 처리하고, 그 움직임에 반응하는 환경의 변화만 생성 모델(Generative Modeling)에게 맡기는 방식이죠. 개발자 입장에서 보면 아주 합리적인 아키텍처입니다.

🔹 Step 1: Kinematics Control 로봇의 URDF 설정값과 액션 시퀀스를 바탕으로 로봇의 3D 궤적을 먼저 계산합니다. 이 궤적은 Pointmap(포인트맵) 시퀀스로 투영되는데, 이건 단순한 좌표값이 아니라 모델이 시각적으로 이해할 수 있는 ‘시공간적 가이드라인’ 역할을 합니다.

🔹 Step 2: 4D Generative Modeling 이제 이 포인트맵과 초기 이미지를 VAE Encoder에 태웁니다. 여기에 Occupancy-aligned robot mask를 결합하는데, 이게 신의 한 수입니다. 로봇이 차지하는 공간을 마스킹해서 디노이징 과정 중에 로봇 형태가 뭉개지거나 배경이랑 섞이는 현상을 원천 차단하거든요.

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

# Kinema4D의 핵심 데이터 흐름 (Conceptual)

input_action = get_robot_actions() # [T, 7] (Joint angles)

robot_urdf = load_robot_model("franka_emika.urdf")

# 1. 기구학을 통한 4D 궤적 생성

robot_trajectory_4d = compute_kinematics(robot_urdf, input_action)

pointmap_seq = project_to_pointmap(robot_trajectory_4d)

# 2. Diffusion Transformer를 통한 환경 반응 생성

# noise와 pointmap_seq, visual_context를 결합

generated_world = dit_model.denoise(

latent_noise,

condition=pointmap_seq,

mask=robot_occupancy_mask

)

# Output: Synchronized RGB + Pointmap (4D sequence)

이미지 2: 아키텍처 개요. 액션이 포인트맵이라는 시각적 신호로 변환되어 DiT의 강력한 가이드가 되는 구조죠.

이미지 2: 아키텍처 개요. 액션이 포인트맵이라는 시각적 신호로 변환되어 DiT의 강력한 가이드가 되는 구조죠.

⚔️ 기존 스택 vs Kinema4D: 진짜 쓸만한가?

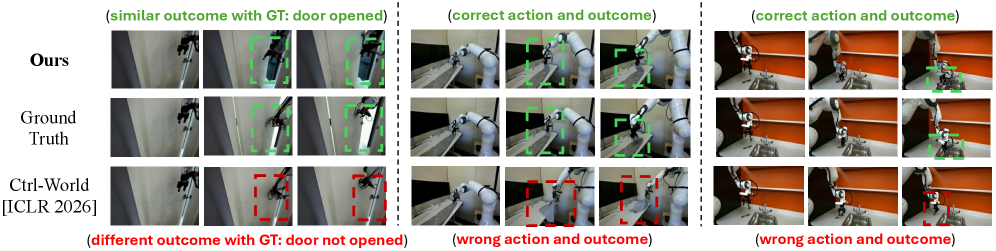

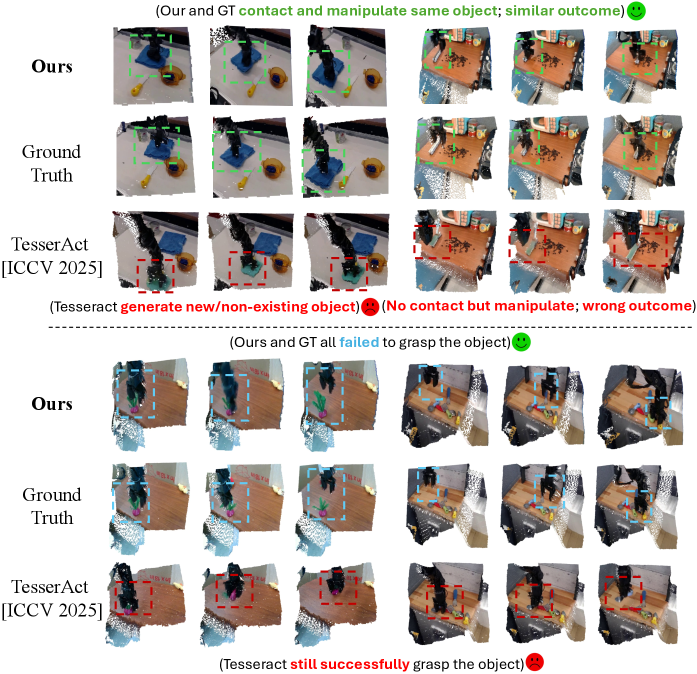

솔직히 기존의 Ctrl-World나 TesserAct 같은 모델들, 데모 영상은 예쁘지만 실제 로봇 제어 정책(Policy) 학습에 쓰기엔 데이터 정밀도가 떨어졌습니다. Kinema4D는 Robo4D-200k라는 대규모 데이터셋(DROID, Bridge, RT-1 등 집대성)을 통해 이 격차를 벌렸습니다.

| 비교 항목 | 전통적 시뮬레이터 (PyBullet) | 2D 비디오 생성 (Ctrl-World) | Kinema4D (Ours) |

|---|---|---|---|

| 물리적 사실성 | 매우 높음 (단순 환경) | 낮음 (Halleucination) | 높음 (Data-driven) |

| 시각적 복잡도 | 낮음 (Texture 미흡) | 높음 | 매우 높음 |

| 공간적 일관성 | 완벽함 | 부족함 (Depth 무시) | 우수함 (4D Pointmap) |

| 추론 속도 | 매우 빠름 | 보통 | 보통 (DiT 기반) |

| 데이터 확장성 | 어려움 (모델링 필요) | 쉬움 | 쉬움 (Robo4D-200k) |

표를 보면 아시겠지만, Kinema4D는 비주얼 퀄리티와 기하학적 정확도 사이의 ‘타협점’을 아주 잘 잡았습니다. 특히 2D 뷰에서는 겹쳐 보이지만 실제로는 떨어져 있는 ‘Near-miss’ 상황을 정확히 구분해낸다는 점이 소름 돋는 포인트입니다.

이미지 3: 모델의 성능은 결국 데이터에서 나오죠. 20만 개 이상의 에피소드를 4D로 정밀하게 라벨링했습니다.

이미지 3: 모델의 성능은 결국 데이터에서 나오죠. 20만 개 이상의 에피소드를 4D로 정밀하게 라벨링했습니다.

🚀 내일 당장 프로덕션에 도입한다면?

이 기술을 실제 현장에 적용한다면 어떤 그림이 그려질까요? 단순히 ‘멋진 영상 만들기’는 아닐 겁니다.

Sim-to-Real을 위한 가상 사고 실험: 로봇이 물체를 놓치거나, 장애물에 살짝 부딪히는 ‘Corner Case’를 생성할 수 있습니다. 기존 시뮬레이터는 이런 미묘한 물리 반응을 수식으로 정의해야 했지만, Kinema4D는 데이터로부터 학습된 ‘반응성’을 보여줍니다. GPU 메모리만 넉넉하다면 수만 가지의 실패 시나리오를 자동으로 구워낼 수 있죠.

Embodiment-agnostic 정책 검증: Kinema4D는 로봇의 URDF만 바꾸면 다른 로봇으로 시뮬레이션이 가능합니다. Franka 팔로 학습한 모델이더라도, Kinematics 정보만 제대로 주면 다른 그리퍼에서의 상호작용을 4D로 예측해 볼 수 있다는 뜻입니다. 새로운 하드웨어를 도입하기 전 소프트웨어 테스트 비용을 획기적으로 줄여줄 겁니다.

이미지 4: 기존 모델들은 액션이 커지면 화면이 뭉개지는데, Kinema4D는 끝까지 형태를 유지합니다.

이미지 4: 기존 모델들은 액션이 커지면 화면이 뭉개지는데, Kinema4D는 끝까지 형태를 유지합니다.

🧐 Tech Lead’s Honest Verdict

Pros:

- 공간 지능의 승리: 2D 픽셀에 집착하지 않고 Pointmap을 사용해 3D 공간감을 살린 것은 천재적인 선택입니다.

- Zero-shot Transfer 가능성: 한 번도 본 적 없는 환경에서도 URDF 기반 가이드 덕분에 꽤 준수한 4D 시퀀스를 뽑아냅니다.

- 데이터셋의 가치: Robo4D-200k는 그 자체로도 로봇 학습 커뮤니티에 엄청난 자산이 될 겁니다.

Cons:

- 연산 비용의 압박: DiT(Diffusion Transformer) 기반이라 실시간(Real-time) 시뮬레이션은 아직 멀었습니다. 에이전트가 생각할 때마다 디퓨전을 돌려야 한다면 서빙 비용이 감당 안 될 수도 있죠.

- 물리 엔진의 부재: 어디까지나 ‘생성’ 모델입니다. 아주 정밀한 물리적 충격량 계산이나 마찰력 등이 중요한 케이스에서는 여전히 전통적인 시뮬레이터가 필요할 겁니다.

이미지 5: 특히 ‘아슬아슬하게 비껴가는’ 상황에서의 뎁스 정확도는 이 모델의 진가를 보여줍니다.

이미지 5: 특히 ‘아슬아슬하게 비껴가는’ 상황에서의 뎁스 정확도는 이 모델의 진가를 보여줍니다.

최종 판결: 단순한 비디오 생성이 지겨워진 AI 엔지니어라면 당장 논문을 뜯어보고 깃허브를 클론하세요. 아직 프로덕션 환경에서 실시간 시뮬레이터로 쓰기엔 무겁지만, 데이터 증강(Data Augmentation) 도구로서는 현존 최강입니다. v2에서 속도 개선만 이뤄진다면 진짜 ‘매트릭스’ 같은 로봇 훈련장이 열릴지도 모르겠네요.