[2026-02-17] LoRWeB: 시각적 유추 학습의 혁명, LoRA 기저(Basis) 분해를 통한 동적 이미지 편집 기술 심층 분석

1. Executive Summary (핵심 요약)

인공지능 이미지 생성 및 편집 분야는 텍스트 프롬프트(Text-to-Image) 중심에서 이미지 예시를 통한 직관적 제어(Visual Analogy)로 그 패러다임이 이동하고 있습니다. NVIDIA Research에서 발표한 LoRWeB(LoRA Weight Basis)는 이러한 흐름의 정점에 서 있는 기술입니다. 기존의 시각적 유추 연구들이 단일 LoRA(Low-Rank Adaptation) 모듈의 고정된 용량 내에서 모든 변환을 학습하려 했던 한계를 지적하며, LoRWeB은 ‘LoRA들의 공간(Space of LoRAs)’을 정의하고 이를 동적으로 조합하는 아키텍처를 제안합니다.

핵심은 간단하면서도 강력합니다. 학습 가능한 기저(Basis) LoRA 모듈 세트를 구축하고, 입력된 유추 쌍 ${a, a’}$의 특징을 추출하여 이들을 가중합(Weighted Sum)함으로써 특정 작업에 최적화된 ‘커스텀 LoRA’를 추론 시점에 즉석에서 생성합니다. 이 방식은 제로샷(Zero-shot) 환경에서 미지의 시각적 변환에 대한 일반화 능력을 극적으로 향상시켰으며, 정량적/정성적 평가 모두에서 기존 SOTA(State-of-the-Art) 모델들을 압도하는 성과를 거두었습니다. 본 리포트에서는 LoRWeB의 아키텍처와 수학적 원리, 그리고 산업적 파급력을 심층적으로 분석합니다.

2. Introduction & Problem Statement (연구 배경 및 문제 정의)

시각적 유추(Visual Analogy)의 난제

시각적 유추란 “$a$가 $a’$이 된 것처럼, $b$를 $b’$으로 바꾸어라($a : a’ :: b : b’$)”라는 지시를 AI가 수행하는 것을 의미합니다. 이는 인간에게는 매우 직관적인 작업이지만, 컴퓨터 비전 모델에게는 극도로 복잡한 문제입니다. 텍스트로 설명하기 힘든 미묘한 화풍의 변화, 사물의 기하학적 변형, 혹은 복합적인 속성(재질, 조명, 스타일)의 동시 전이를 포함하기 때문입니다.

기존 접근법의 한계: Fixed Capacity Bottleneck

기존의 방법론들은 주로 사전 학습된 확산 모델(Diffusion Models)에 단일 LoRA 모듈을 추가하여 유추 작업을 학습시켰습니다. 그러나 여기에는 결정적인 결함이 존재합니다.

- 표현력의 한계: 단일 LoRA 모듈은 고정된 랭크(Rank)를 가지며, 이는 수많은 시각적 변환의 다양성을 모두 담아내기에 역부족입니다.

- 일반화의 부재: 학습 데이터셋에 포함되지 않은 새로운 유형의 변환(Unseen tasks)이 주어졌을 때, 고정된 가중치는 유연하게 대처하지 못하고 붕괴하거나 입력 이미지 $b$의 정체성을 잃어버리는 현상이 발생합니다.

- 간섭(Interference): 서로 다른 변환들이 하나의 가중치 공간 내에서 충돌하며 성능 저하를 유발합니다.

LoRWeB은 이러한 병목 현상을 해결하기 위해 ‘동적 가중치 합성(Dynamic Weight Composition)’이라는 개념을 도입했습니다.

3. Core Methodology (핵심 기술 및 아키텍처 심층 분석)

LoRWeB의 아키텍처는 크게 세 가지 구성 요소로 나뉩니다: (1) 시각적 특징 추출을 위한 인코더, (2) 변환 프리미티브를 저장하는 LoRA 기저 세트, (3) 조건부 플로우 매칭(Flow-matching) 기반의 생성 백본입니다.

![Figure 2:LoRWeB Overview.We first encode𝐚{\mathbf{a}}and𝐚′{\mathbf{a}}^{\prime}, that describe a visual transformation (e.g.adding a hat to the man), and𝐛{\mathbf{b}}, which should be edited analogously (e.g.adding a hat to the woman) with CLIP[42], and a small learned projection module. The similarity between the encoded vector and a set of learned keys determines the linear coefficients for combining the learned LoRAs into a single, mixed LoRA. This mixed LoRA is injected into a conditional flow model (e.g.Flux.1-Kontext[5]). Next, we build a2×22\times 2composite image from{𝐚,𝐚′,𝐛}\,{\mathbf{a}}^{\prime},{\mathbf{b}}}. The conditional flow model gets this composite image as its input, along with a guiding edit prompt, and produces a composite image with the edited results𝐛′{\mathbf{b}}^{\prime}in the bottom-right quadrant.](https://www.opsoai.com/assets/img/papers/2602.15727/x2.png) Figure 2: LoRWeB의 전체 아키텍처 개요. 입력 쌍의 관계를 인코딩하여 최적의 LoRA 조합 가중치를 계산하고 이를 모델에 주입하는 과정을 보여줍니다.

Figure 2: LoRWeB의 전체 아키텍처 개요. 입력 쌍의 관계를 인코딩하여 최적의 LoRA 조합 가중치를 계산하고 이를 모델에 주입하는 과정을 보여줍니다.

3.1. LoRA Basis Decomposition (LoRA 기저 분해)

LoRWeB의 가장 혁신적인 부분은 가중치 공간을 선형 결합의 형태로 모델링한 것입니다. $N$개의 독립적인 LoRA 모듈 ${L_1, L_2, …, L_N}$을 ‘기저(Basis)’로 정의합니다. 특정 작업 $T$에 필요한 최종 LoRA 가중치 $W_T$는 다음과 같이 계산됩니다.

\[W_T = \sum_{i=1}^{N} w_i \cdot L_i\]여기서 $w_i$는 인코더에 의해 결정되는 스칼라 가중치입니다. 이는 마치 푸리에 변환에서 기본 주파수들을 조합해 복잡한 신호를 만드는 것과 유사합니다. 각각의 기저 LoRA는 특정 유형의 시각적 변환(예: 색상 변경, 사물 추가, 스타일 변이)에 특화된 프리미티브(Primitive) 역할을 수행하게 됩니다.

3.2. Dynamic Weighting Encoder (동적 가중치 인코더)

입력 이미지 $a, a’, b$는 CLIP 인코더를 통해 임베딩됩니다. 특히 $a$와 $a’$ 사이의 관계를 포착하기 위해 두 이미지의 임베딩 차이(Difference vector)와 결합된 특징을 사용합니다. 이 특징 벡터는 학습 가능한 ‘키(Keys)’와 내적(Dot-product)을 통해 유사도가 계산되며, Softmax 함수를 거쳐 최종 가중치 $w$를 생성합니다.

이 과정은 ‘Weight-space Attention’이라고 부를 수 있습니다. 모델은 현재 유추 작업이 어떤 성격인지 판단하고, 그에 가장 적합한 기저 LoRA들을 선택적으로 활성화합니다.

3.3. Conditional Flow Model (Flux.1-Kontext)

생성 백본으로는 최신 Flow-matching 모델인 Flux.1-Kontext를 활용합니다. LoRWeB은 생성된 혼합 LoRA를 이 백본의 Transformer 레이어에 주입합니다. 또한, 입력 이미지들을 $2 \times 2$ 그리드로 배치하여 모델이 공간적 맥락을 직접 참조할 수 있도록 설계되었습니다. 이 구조 덕분에 모델은 텍스트 프롬프트에 의존하지 않고도 이미지 간의 픽셀 수준 대응 관계를 정확히 파악할 수 있습니다.

4. Implementation Details & Experiment Setup (구현 및 실험 환경)

데이터셋 및 학습 전략

LoRWeB은 수만 개의 시각적 유추 쌍을 포함하는 대규모 데이터셋으로 학습되었습니다. 학습 과정에서 모델은 단순히 정답 이미지 $b’$을 재구성하는 것을 넘어, 기저 LoRA들이 서로 보완적인 정보를 학습하도록 유도됩니다.

- Base Model: Flux.1 (Flow-based Generative Model)

- Rank ($r$): 각 기저 LoRA는 효율성을 위해 낮은 랭크(예: $r=16$)를 유지합니다.

- Basis Count ($N$): 실험 결과 $N=16$ 또는 $32$ 정도의 기저로도 충분히 광범위한 변조 공간을 커버할 수 있음이 증명되었습니다.

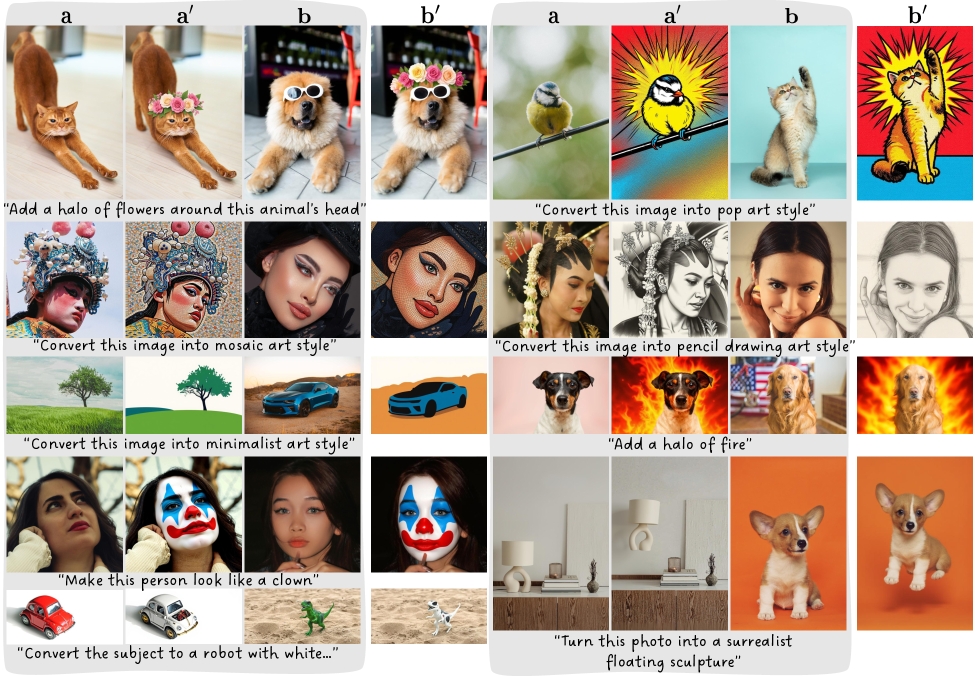

Figure 3: LoRWeB의 시각적 유추 결과물. 객체 추가, 메이크업 전이, 포즈 변경 등 매우 다양한 작업에 대해 높은 품질의 결과물을 생성합니다.

Figure 3: LoRWeB의 시각적 유추 결과물. 객체 추가, 메이크업 전이, 포즈 변경 등 매우 다양한 작업에 대해 높은 품질의 결과물을 생성합니다.

5. Comparative Analysis (성능 평가 및 비교)

5.1. 질적 비교 (Qualitative Results)

LoRWeB은 기존의 단일 LoRA 기반 모델이나 I2I(Image-to-Image) 프레임워크와 비교했을 때, 두 가지 측면에서 압도적인 우위를 점합니다.

- Identity Preservation: 원본 이미지 $b$의 핵심 특징(얼굴 구조, 배경 등)을 완벽하게 유지합니다.

- Analogy Accuracy: 유추 쌍 $a \to a’$에서 제시된 변환의 의도를 정확하게 $b’$에 투영합니다.

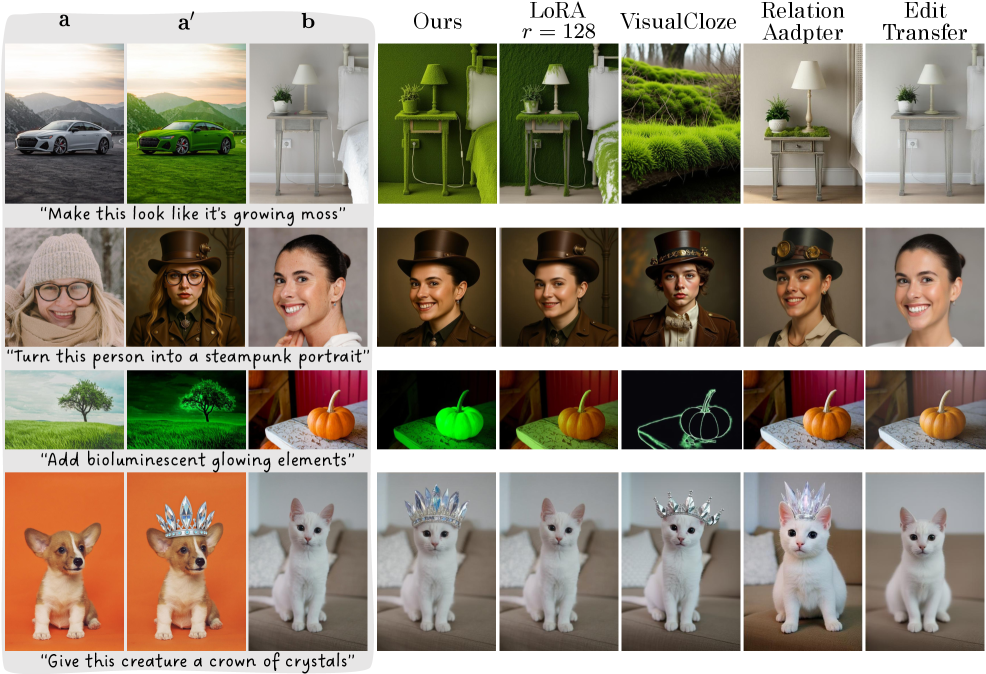

Figure 4: 타 모델과의 비교. 타사 모델들이 $b$의 세부 사항을 뭉개거나 변환을 제대로 적용하지 못하는 반면, LoRWeB은 정확한 변환을 수행합니다.

Figure 4: 타 모델과의 비교. 타사 모델들이 $b$의 세부 사항을 뭉개거나 변환을 제대로 적용하지 못하는 반면, LoRWeB은 정확한 변환을 수행합니다.

5.2. 양적 비교 (Quantitative Results)

성능 측정을 위해 Gemma-3(VLM)를 활용한 편집 정확도 평가와 LPIPS/CLIP 거리 기반의 보존력 평가가 수행되었습니다.

![Figure 5:Quantitative comparisons.(left) Accuracy of the applied edit and preservation of𝐛{\mathbf{b}}in𝐛′{\mathbf{b}}^{\prime}using Gemma-3[52]. Top right is better. (right) CLIP directional similarity and LPIPS between𝐛′{\mathbf{b}}^{\prime}and𝐛{\mathbf{b}}. Bottom-right is better. Our method pushes the Pareto front of edit accuracy-preservation, achieving higher edit accuracy while strongly preserving the input image.](https://www.opsoai.com/assets/img/papers/2602.15727/x5.png) Figure 5: 정량적 지표 분석. LoRWeB은 편집 정확도와 이미지 보존력 사이의 파레토 최전선(Pareto Front)을 확장하며 두 마리 토끼를 모두 잡는 데 성공했습니다.

Figure 5: 정량적 지표 분석. LoRWeB은 편집 정확도와 이미지 보존력 사이의 파레토 최전선(Pareto Front)을 확장하며 두 마리 토끼를 모두 잡는 데 성공했습니다.

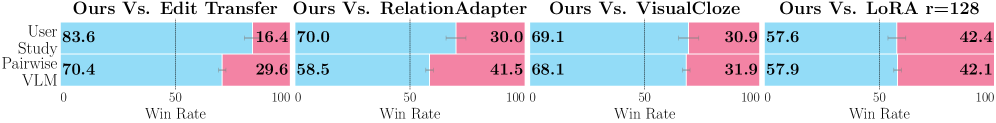

사용자 선호도 조사(User Study)에서도 LoRWeB은 타 모델 대비 70% 이상의 높은 선택을 받으며 실제 시각적 품질의 우수성을 입증했습니다.

Figure 6: 사용자 및 VLM 기반 선호도 비교. 모든 지표에서 LoRWeB이 경쟁 모델을 압도하는 모습을 보입니다.

Figure 6: 사용자 및 VLM 기반 선호도 비교. 모든 지표에서 LoRWeB이 경쟁 모델을 압도하는 모습을 보입니다.

6. Real-World Application & Impact (실제 적용 분야 및 글로벌 파급력)

LoRWeB의 기술적 가치는 단순한 연구 수준을 넘어 산업 전반에 막대한 영향을 미칠 수 있습니다.

- 차세대 이커머스 및 광고 디자인: 특정 제품의 스타일(색상, 재질)을 다른 제품군으로 전이하거나, 모델의 의상을 한 번의 예시 클릭만으로 교체하는 작업이 가능해집니다. 이는 광고 제작 비용을 획기적으로 절감합니다.

- 개인화된 콘텐츠 생성: 사용자가 선호하는 특정 화풍이나 캐릭터 스타일을 단 몇 장의 사진만으로 학습시켜, 자신의 사진을 해당 스타일로 변환하는 앱 서비스에 적용될 수 있습니다.

- 의료 및 제조 데이터 증강(Data Augmentation): 희귀 질병의 의료 영상이나 제조 공정의 결함 사례가 부족할 때, 정상 영상에 결함 발생 유추 쌍을 적용하여 고품질의 학습 데이터를 생성할 수 있습니다.

- 창작자의 도구: 복잡한 텍스트 프롬프트를 작성하는 대신, “이 느낌을 저기에 적용해줘”라는 식의 직관적인 UI/UX를 제공함으로써 비전문가도 수준 높은 이미지 편집이 가능해집니다.

7. Discussion: Limitations & Critical Critique (한계점 및 기술적 비평)

전문가적 시각에서 LoRWeB이 완벽한 것은 아닙니다. 몇 가지 비판적 검토가 필요합니다.

- Basis Selection의 임의성: 기저의 개수 $N$을 정하는 과정이 휴리스틱에 의존합니다. 기저가 너무 적으면 복잡한 변환을 표현하지 못하고, 너무 많으면 학습이 불안정해지거나 오버피팅(Overfitting)의 위험이 있습니다.

- 계산 복잡도: 추론 시 매번 인코더를 거쳐 가중합을 계산하고 이를 Transformer 레이어에 업데이트하는 과정은 단일 모델 대비 추가적인 오버헤드를 발생시킵니다. 실시간 애플리케이션에서는 최적화가 필수적입니다.

- Out-of-Distribution (OOD) 문제: 학습된 기저들이 커버하지 못하는 완전히 새로운 차원의 시각적 개념(예: 4차원적 기하학 변형 등)이 주어졌을 때, 선형 결합만으로 이를 표현할 수 있을지는 의문입니다. 가중치 공간의 ‘외삽(Extrapolation)’ 능력에 대한 추가 연구가 필요합니다.

8. Conclusion (결론 및 인사이트)

LoRWeB은 고정된 파라미터라는 인공지능 모델의 한계를 ‘기저 분해’와 ‘동적 합성’이라는 영리한 접근법으로 해결했습니다. 이는 비단 시각적 유추뿐만 아니라, LLM(거대언어모델)이나 로보틱스 제어 등 다양한 도메인에서 ‘작업 맞춤형 동적 적응(Task-specific Dynamic Adaptation)’이 가야 할 방향을 제시하고 있습니다.

이미지 편집의 미래는 이제 더 이상 복잡한 텍스트 설명에 의존하지 않습니다. LoRWeB은 시각적 예시만으로 모델과 소통하는 시대를 앞당겼으며, 이는 생성 AI의 사용자 경험을 근본적으로 변화시킬 것입니다.

9. Expert’s Touch (전문가의 시선)

“모델 가중치의 커널 공간을 직접 핸들링하는 LoRWeB은 Hypernetwork와 LoRA의 정수를 결합한 결과물이다.”

- 한 줄 평: 텍스트 프롬프트의 불확실성을 이미지 기저 벡터의 선형 결합으로 치환하여 제어 가능성(Controllability)의 새로운 표준을 세웠습니다.

- 기술적 제언: 현재는 단순 선형 결합($\sum w_i L_i$)을 사용하지만, 기저들 사이의 비선형 상호작용을 모델링하는 Attention 기반의 가중치 믹싱이 도입된다면 더욱 정교한 변환이 가능할 것입니다.

- 오픈소스 및 실무 적용: Flux.1 엔진을 기반으로 하고 있어 기존 Stable Diffusion 에코시스템과의 호환성이 높습니다. 실무자들은 기업 고유의 ‘디자인 기저(Design Basis)’를 미리 학습시켜 두면, 일관된 브랜드 아이덴티티를 유지하면서도 무한한 시안을 생성하는 파이프라인을 구축할 수 있을 것입니다.