[2026-02-20] VLANeXt: 최강의 VLA 모델 구축을 위한 12가지 레시피와 로봇 AI 인프라 최적화 전략

VLANeXt: 최강의 VLA 모델 구축을 위한 12가지 레시피와 로봇 AI 인프라 최적화 전략

Meta Description: VLANeXt 논문을 통해 로봇 제어를 위한 VLA 모델의 핵심 설계 원칙 12가지를 분석하고, 클라우드 컴퓨팅 인프라 최적화 및 기업용 AI 솔루션 도입 전략을 살펴봅니다.

최근 로보틱스 분야에서는 시각 지능과 언어 이해를 행동 제어와 결합한 VLA(Vision-Language-Action) 모델이 비약적인 발전을 이루고 있습니다. 하지만 파편화된 학습 프로토콜로 인해 어떤 설계 요소가 실질적인 성능 향상을 이끄는지 파악하기 어려웠습니다. 본 포스팅에서는 최신 연구인 VLANeXt가 제시하는 강력한 VLA 구축 레시피와 이를 통한 기업용 AI 솔루션의 효율적인 배포 전략을 심층 분석합니다.

[1] 핵심 요약 (Executive Summary)

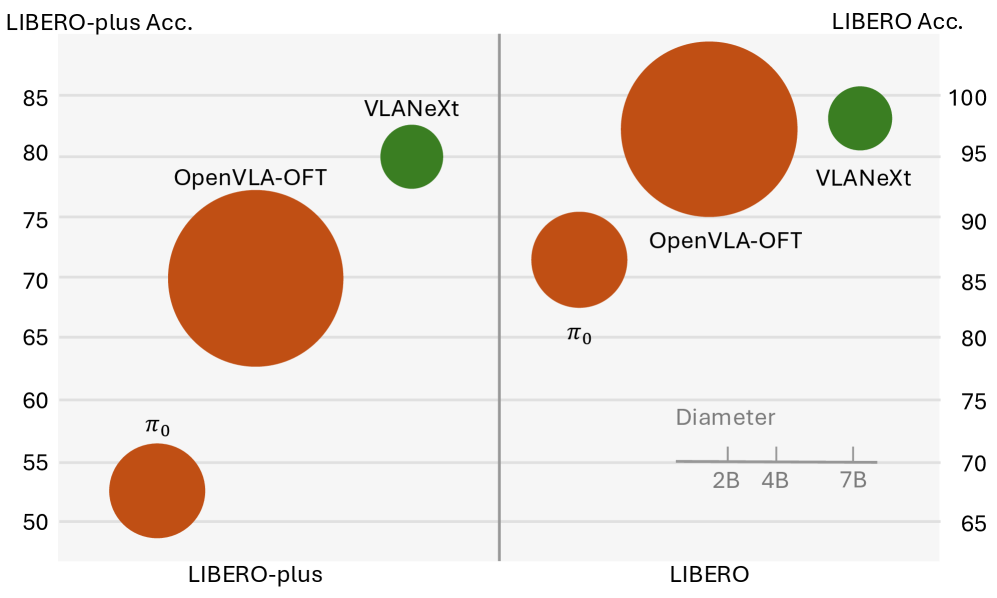

- 통합 프레임워크 제안: RT-2 및 OpenVLA를 기반으로 VLA 설계 공간을 체계적으로 분석하여 12가지 핵심 기술적 발견(Findings) 도출.

- VLANeXt 모델 개발: 2.5B 수준의 경량화된 파라미터로도 7B 규모의 기존 SOTA(OpenVLA)를 능가하는 성능 달성.

- 벤치마크 압도: LIBERO 및 LIBERO-plus 벤치마크에서 일반화 성능 및 강건성(Robustness) 입증.

- 비즈니스 효율성: 모델 경량화를 통해 GPU 서버 호스팅 비용 절감 및 클라우드 컴퓨팅(Cloud Computing) 리소스 최적화 가능.

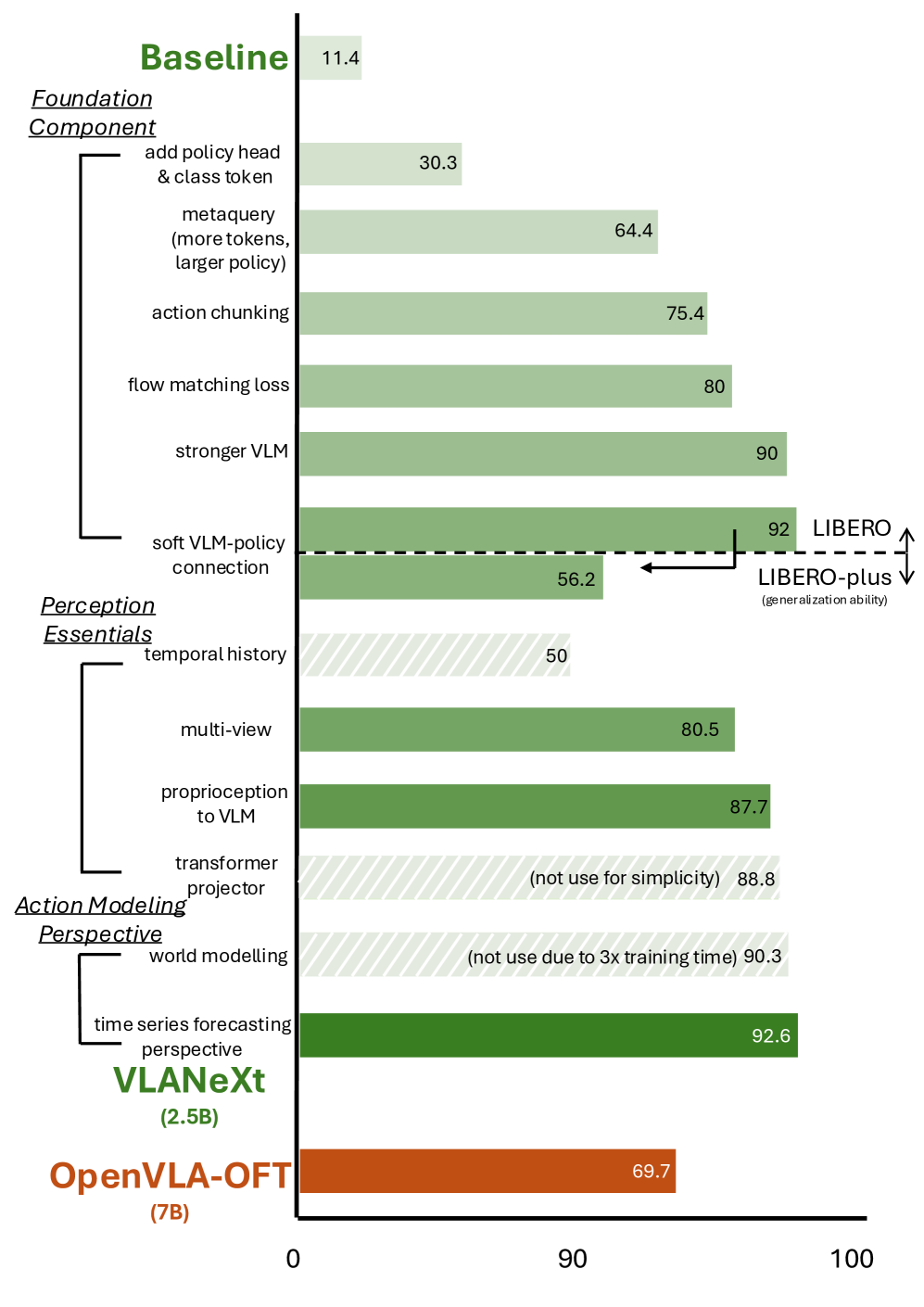

Figure 1: VLANeXt는 더 적은 파라미터로도 LIBERO-plus 등 고난도 환경에서 뛰어난 성공률을 보여줍니다.

Figure 1: VLANeXt는 더 적은 파라미터로도 LIBERO-plus 등 고난도 환경에서 뛰어난 성공률을 보여줍니다.

[2] 연구 배경 및 문제 정의 (Background)

기존의 VLA 모델들은 각기 다른 데이터셋, 토크나이저, 백본 아키텍처를 사용하여 성능의 근원을 특정하기 어려웠습니다. 특히 기업용 AI 솔루션 도입 시, 대규모 파라미터로 인한 인프라 비용 부담과 실시간 제어의 지연 시간(Latency) 문제는 상용화의 큰 걸림돌이었습니다. VLANeXt 연구팀은 이러한 혼란을 잠재우고, 실제 산업 현장에 즉시 적용 가능한 인프라 최적화된 모델 설계 가이드를 구축하고자 했습니다.

[3] 핵심 기술 및 아키텍처 심층 분석 (Core Methodology)

연구진은 VLA 설계를 크게 세 가지 차원(기초 구성 요소, 지각 요소, 행동 모델링)에서 분석했습니다.

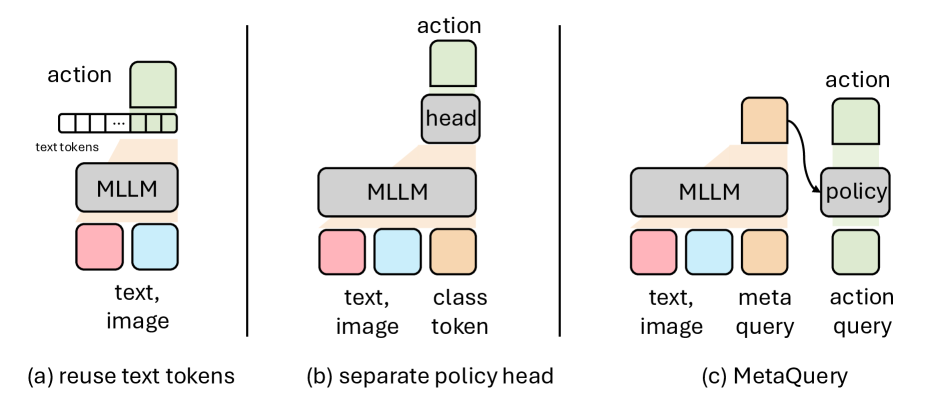

3.1. 정책 모듈(Policy Module) 설계

VLA 모델의 핵심은 시각적 입력과 텍스트 명령을 어떻게 물리적 행동 토큰으로 변환하느냐에 있습니다. VLANeXt는 기존 Decoder-only 방식의 한계를 극복하기 위해 다양한 연결 구조를 실험했습니다.

Figure 3: Policy Module의 아키텍처 선택에 따른 성능 변화를 분석하여 최적의 구조를 도출합니다.

Figure 3: Policy Module의 아키텍처 선택에 따른 성능 변화를 분석하여 최적의 구조를 도출합니다.

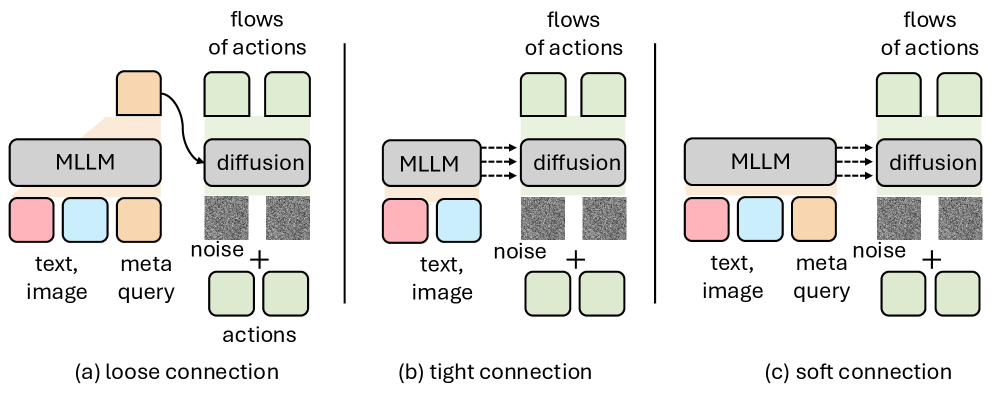

3.2. VLM과 정책 모듈의 연결 구조

비주얼 특징 추출기(Vision Encoder)와 언어 모델 간의 정렬(Alignment)은 데이터 보안 및 컴플라이언스를 유지하면서도 고수준의 추론을 수행하는 데 필수적입니다.

Figure 4: 특징 융합(Feature Fusion) 방식의 최적화를 통해 인프라 부하를 최소화합니다.

Figure 4: 특징 융합(Feature Fusion) 방식의 최적화를 통해 인프라 부하를 최소화합니다.

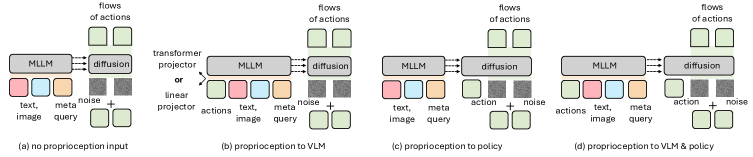

3.3. 고유 수용 감각(Proprioception) 컨디셔닝

로봇의 현재 상태 정보를 입력으로 활용하는 방식에 따라 작업 성공률이 크게 달라집니다. VLANeXt는 이를 효율적으로 결합하는 방식을 제안하여 실시간성을 확보했습니다.

Figure 5: Proprioception 데이터의 효과적인 주입은 정밀 제어의 핵심입니다.

Figure 5: Proprioception 데이터의 효과적인 주입은 정밀 제어의 핵심입니다.

[4] 기업 적용 및 비즈니스 임팩트 (Practical Application)

VLANeXt의 연구 결과는 단순한 학술적 성과를 넘어 B2B SaaS 및 스마트 팩토리 솔루션에 막대한 경제적 가치를 제공합니다.

- 클라우드 컴퓨팅 비용 최적화 (Cloud Optimization): 7B 모델 대신 2.5B 규모의 VLANeXt를 활용함으로써 AWS, GCP, Azure 상의 GPU 인스턴스 비용을 50% 이상 절감할 수 있습니다. 이는 AI 도입 ROI를 극대화하는 핵심 요소입니다.

- 엣지 컴퓨팅 및 데이터 보안: 모델 사이즈가 작아짐에 따라 로컬 서버 배포가 용이해졌습니다. 이는 민감한 제조 공정 데이터를 외부로 유출하지 않는 데이터 보안 및 컴플라이언스 강화로 이어집니다.

- Enterprise AI 솔루션 확장성: 통일된 레시피를 통해 물류, 조립, 서비스 로봇 등 다양한 도메인에 특화된 모델을 빠르게 파인튜닝(Fine-tuning)하여 시장 점유율을 높일 수 있습니다.

Figure 2: 초기 베이스라인에서 VLANeXt로 진화하는 과정에서의 성능 향상 궤적. 기술 투자의 효율성을 입증합니다.

Figure 2: 초기 베이스라인에서 VLANeXt로 진화하는 과정에서의 성능 향상 궤적. 기술 투자의 효율성을 입증합니다.

[5] 전문가의 시선 (Expert’s Touch)

기술 리더의 한 줄 평

“VLANeXt는 모델의 거대화 경쟁에서 벗어나, 데이터와 아키텍처의 ‘효율적 정렬’이 비즈니스 가치를 어떻게 창출하는지 보여주는 이정표입니다.”

엔지니어를 위한 조언 및 한계점

- 인프라 고려 사항: VLANeXt는 경량화되었으나, 여전히 고대역폭 메모리(HBM)를 요구하는 비전 인코더를 포함하고 있습니다. GPU 서버 호스팅 선택 시 추론 속도와 VRAM 용량 간의 균형을 맞추는 최적화 작업이 병행되어야 합니다.

- 실무 팁: 오픈소스 기반의 OpenVLA 코드를 먼저 분석한 뒤, VLANeXt의 12가지 레시피 중 본인의 도메인(예: 물류 로봇의 시각 지능)에 가장 큰 영향을 미치는 요소를 우선 적용해 보시기 바랍니다.

- 미래 전망: 향후 다중 로봇 협업(Multi-agent) 환경에서의 데이터 보안 통신 규약과 VLA의 결합이 차세대 기업용 AI 솔루션의 핵심 격전지가 될 것입니다.